Sostenibilidad

Buques con velas rígidas capaces de ahorrar hasta 3 toneladas de combustible al día

Durante varios meses del año pasado un buque de la empresa Cargill, especializada en el transporte de productos agrícolas y

Durante varios meses del año pasado un buque de la empresa Cargill, especializada en el transporte de productos agrícolas y

Internet es muy grande y una de sus mejores características es que consigue reunir a gente de todo tipo interesada

La suspensión es una parte crucial de la seguridad de un coche, junto a los frenos y los neumáticos. Hablamos

Las calles y carreteras necesitan mantenimiento periódico para combatir el deterioro causado por el tráfico de vehículos, incluidos coches, camiones

El Volvo EX30 nacía siendo el Volvo con la menor huella de carbono fabricado hasta ahora por la marca. Ahora

Es importante conocer el significado de los testigos de tu coche situados en el cuadro de instrumentos. Porque estas lucecitas,

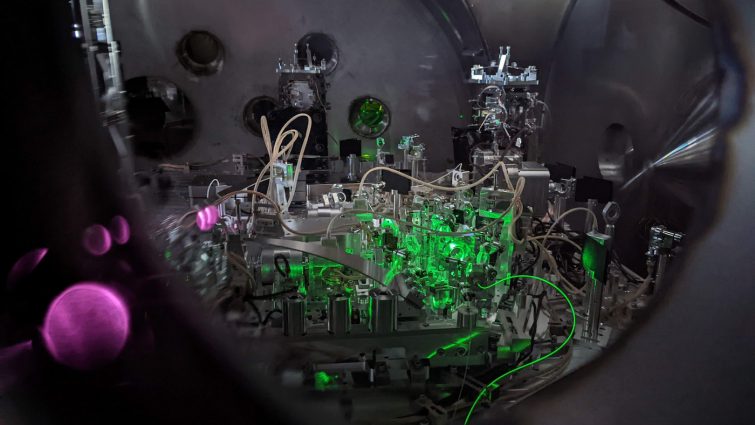

A veces, de los grandes experimentos científicos brotan resultados colaterales que se convierten en utilidades de uso cotidiano. En este

Volvo Cars es una marca que sigue fiel a su compromiso con la seguridad. Lo único que ha cambiado en

Cuando un automóvil pasa por baches mientras conduces, el sistema de suspensión absorbe el impacto. Desempeña un papel importante a

Desde hace años se trabaja en grandes retos relacionados con la navegación y las rutas marítimas que encuentran sus paralelismos

Explora todas las secciones